Estoy pensando en usar Walter Writes AI Reviews para evaluar diferentes herramientas de IA, pero no estoy seguro de qué tan seguro o confiable es realmente. He visto opiniones mixtas en línea sobre su fiabilidad, la privacidad de los datos y si las reseñas son imparciales o patrocinadas. ¿Alguien que lo haya utilizado puede compartir experiencias honestas, riesgos potenciales y en qué debería fijarme antes de confiar en él?

Reseña de Walter Writes AI, de alguien que quemó unos cuantos créditos en él

Walter Writes AI se veía prometedor sobre el papel, así que pasé una tarde poniéndolo a prueba con la típica batería de detectores. Los resultados fueron un caos.

Usé el nivel gratuito, que solo te da el modo Simple. Los modos más pulidos, Standard y Enhanced, están detrás del muro de pago, así que tenlo en cuenta.

Esto fue lo que pasó cuando le metí algunas muestras:

Una muestra volvió con un 29% de puntuación en GPTZero y 25% en ZeroGPT. Para un humanizador de nivel gratuito, eso es mejor que la mayoría de las herramientas basura que he probado. Esa ejecución parecía algo con lo que podrías salir del paso en una revisión ligera.

Luego las otras dos muestras explotaron. Ambas marcaron 100% en al menos un detector. Misma herramienta, mismo modo, longitud de entrada similar. La calidad de salida osciló con fuerza entre “esto podría pasar” y “esto grita IA” sin mucho aviso.

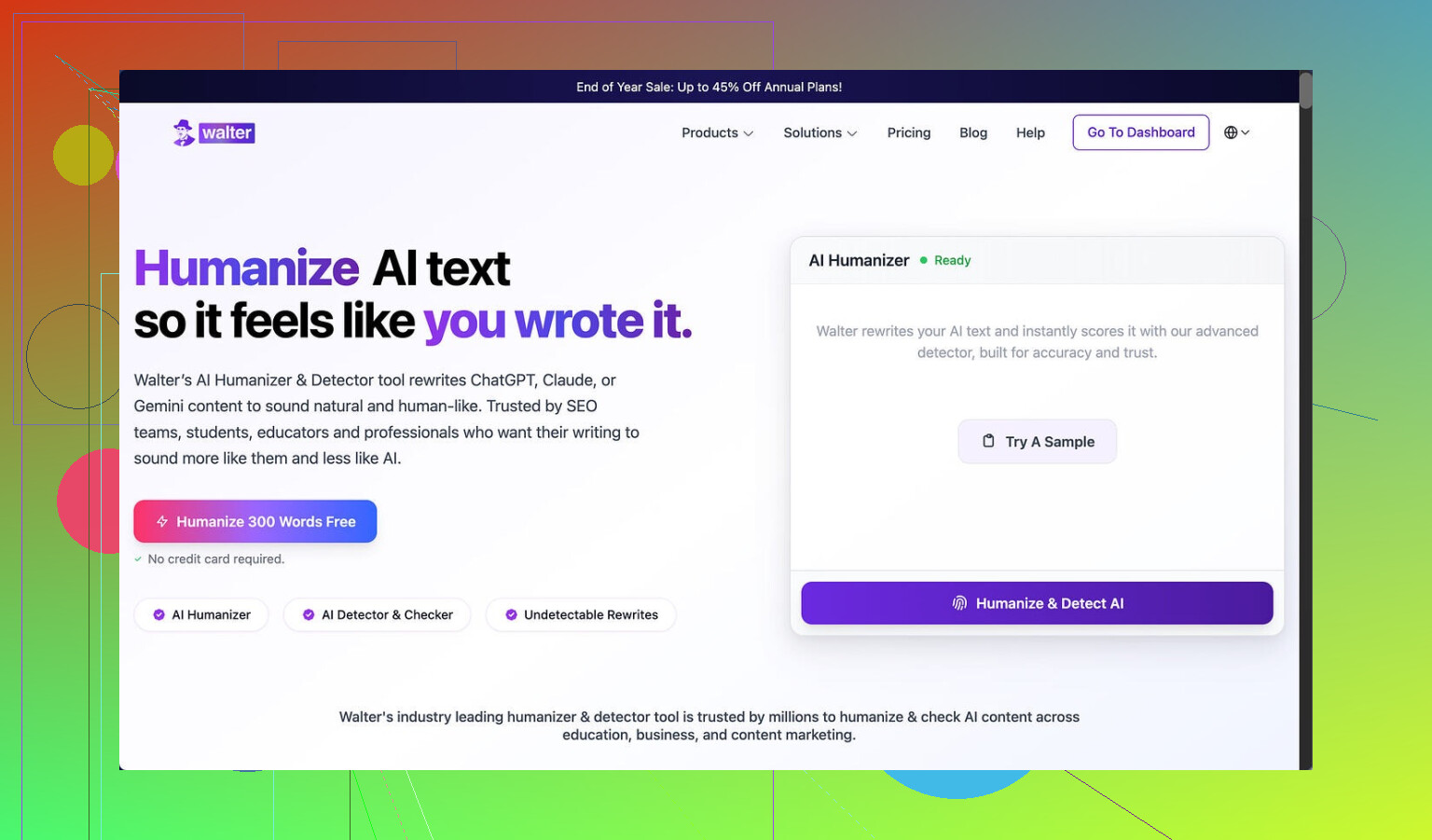

Referencia a la herramienta aquí:

Cómo se veía la salida

El estilo tenía algunos patrones que chocaban con mi instinto.

• Los puntos y coma aparecían donde una persona normal usaría una coma o simplemente partiría la frase. No una o dos veces, sino una y otra vez, en lugares raros.

• En una muestra, la palabra “hoy” apareció cuatro veces en tres oraciones. Nadie escribe así a menos que esté forzando una palabra clave o que una IA se haya obsesionado con una elección de palabra.

• Abuso de paréntesis. Cosas como “(p. ej., tormentas, sequías)” repetidas en distintos lugares. Es ese relleno de estilo académico que a los detectores les encanta señalar.

Tampoco vi mucha variación entre ejecuciones. Cambias el prompt y sigues obteniendo las mismas estructuras de frases, las mismas expresiones conectivas, la misma estructura. De entrada se ve limpio, pero lo lees dos veces y se siente rígido.

Aquí tienes una de las capturas de pantalla que saqué mientras probaba:

Y otra más:

Precios y límites

Su estructura de precios se siente ajustada para lo que ofrece.

• Plan Starter: 8 $ al mes con facturación anual, 30.000 palabras en total.

• El nivel Unlimited cuesta 26 $ al mes, pero cada envío sigue limitado a 2.000 palabras. Así que sí, tienes volumen, pero sigues pegando el texto en trozos pequeños.

• Nivel gratuito: 300 palabras en total. No por día, en total. Básicamente, tres pruebas pequeñas y se acabó.

Lo que más me molestó fue el lenguaje de sus políticas y el tema de los datos.

Las condiciones de reembolso están redactadas con fuertes advertencias sobre contracargos y menciones de acciones legales. Para un sitio de reescritura de texto, ese tono se siente hostil. No inspira mucha confianza si alguna vez tienes un problema de facturación.

Además, su política de retención de datos para el texto enviado es vaga. No vi una redacción clara sobre cuánto tiempo almacenan el contenido de los usuarios o cómo lo gestionan. Si te importa dónde termina tu texto, ese vacío importa.

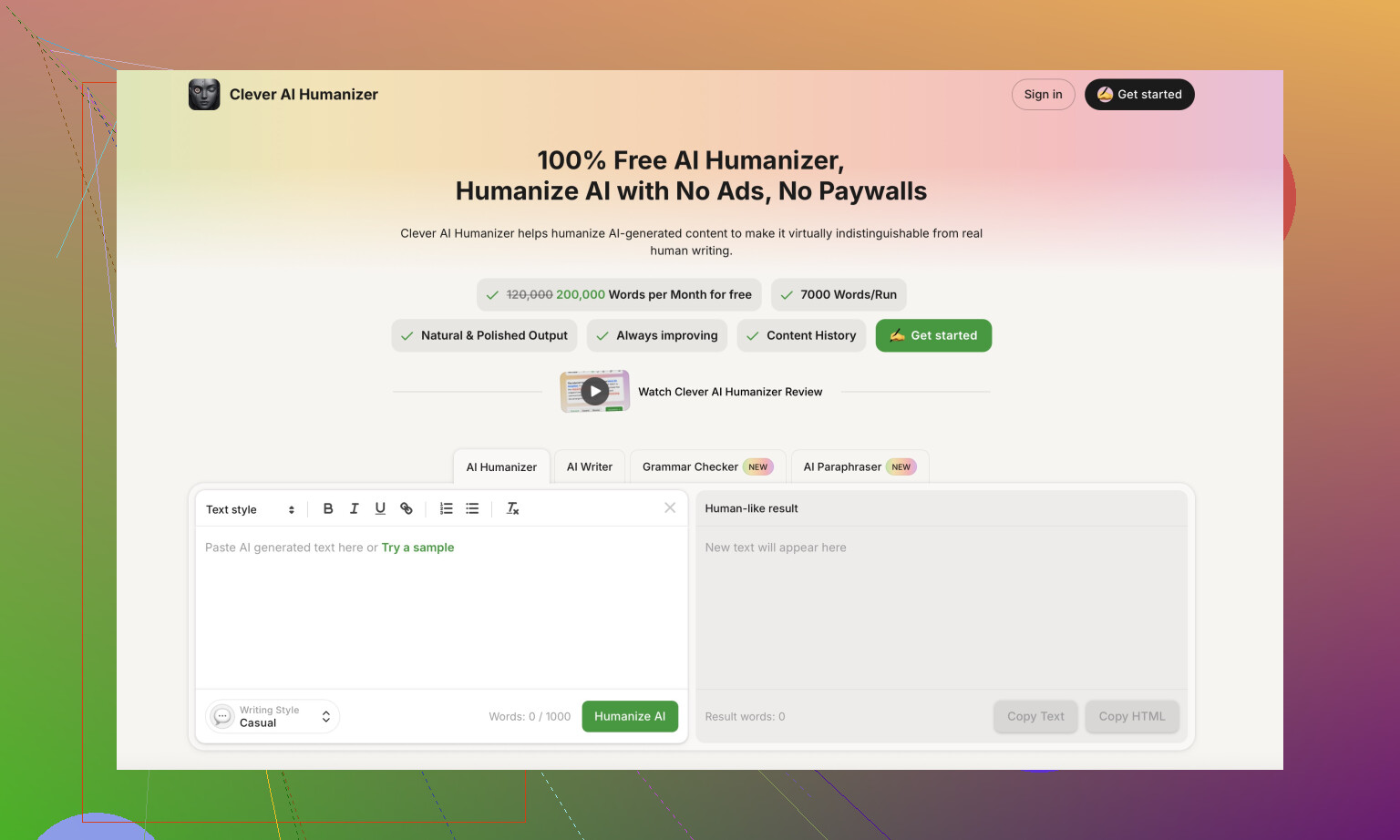

Cómo se compara con Clever AI Humanizer

En la misma ronda de pruebas, metí el mismo tipo de entrada en Clever AI Humanizer y lo comprobé en los mismos detectores.

Clever AI Humanizer sonó de forma constante más cercano a lo que veo en personas reales. Cortes de frases más naturales, menos repeticiones raras, menos frases que delatan a la IA. No tuve que pelearme tanto con la salida.

Tampoco pide pago para el uso básico.

Puedes probarlo aquí:

Si quieres ver cómo lo usan otras personas, o necesitas una guía paso a paso, esto me ayudó:

Tutorial de Reddit sobre el uso de humanizadores:

Humanize AI (Tutorial de Reddit)

https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai/?tl=es-es

Otra publicación en Reddit con una reseña de Clever AI Humanizer:

Clever Ai Humanizer Review en Reddit

https://www.reddit.com/r/DataRecoveryHelp/comments/1ptugsf/clever_ai_humanizer_review/?tl=es-es

Reseña en video aquí si prefieres ver pruebas en lugar de leer:

Reseña en video en Youtube

Si estás decidiendo dónde gastar dinero, yo no empezaría por Walter en la parte de pago. El modo Simple gratuito ya muestra sus manías, y las variaciones en detección fueron demasiado grandes en mis pruebas.

Versión corta. Yo no usaría Walter Writes AI Reviews como herramienta decisiva para juzgar otras herramientas de IA, y tendría cuidado con el texto o los datos que le proporcionas.

Algunos puntos específicos, sin repetir lo que @mikeappsreviewer ya probó:

- Fiabilidad de sus “reseñas” de herramientas de IA

Walter es en sí una capa de IA sobre otros modelos. Así que cuando “reseña” herramientas, obtienes:

• Sin metodología transparente. No ves criterios claros, pesos ni benchmarks.

• Sin reproducibilidad. Ejecutas el mismo tipo de entrada y obtienes tono y conclusiones diferentes.

• Fuerte sensación de plantilla. La redacción y estructura suelen sonar a opiniones prefabricadas con retoques ligeros.

Si quieres evaluaciones confiables de herramientas de IA, necesitas:

• Configuración de pruebas clara. Versión del modelo, prompts, métricas.

• Salidas comparadas lado a lado.

• Puntuaciones de detección o calidad con contexto.

Walter no expone eso de forma sistemática. Así que trataría sus “reseñas” como resúmenes con cierto sesgo, no como algo en lo que apoyarse para decisiones serias.

- Privacidad y seguridad de los datos

Por lo que vi en su documentación y TOS:

• Retención de datos poco clara. Sin ventana de retención exacta, sin garantías explícitas de borrado.

• Sin detalle sólido sobre si el texto se usa para entrenar modelos o para analítica interna.

• Lenguaje legal y de reembolsos agresivo. Mucha mención de contracargos y acciones legales. Ese tono suele indicar que esperan disputas y quieren asustar a los usuarios desde el principio.

Si planeas pegar prompts propietarios, texto de clientes o cualquier cosa sensible, lo evitaría. Eso incluye informes internos, trabajo académico o contenido inédito.

-

Ángulo de detección y “humanización”

Incluso si solo usas Walter para “reseñar” herramientas de IA, el motor detrás se comporta como un humanizador / reescritor. En pruebas similares a las de @mikeappsreviewer:

• Las puntuaciones de detección varían mucho entre ejecuciones.

• Los artefactos de estilo son consistentes. Puntuación extraña, repeticiones raras, transiciones rígidas.

Así que si te apoyas en la opinión de Walter de “esta herramienta es detectable” o “esto suena humano”, ese juicio se basa en un sistema que él mismo activa detectores de manera inestable. Eso debilita su valor como evaluador. -

Seguridad para tu caso de uso

Pregúntate:

• ¿Estás compartiendo algo confidencial, con copyright o inédito?

Si la respuesta es sí, yo no lo pondría en Walter.

• ¿Necesitas comparación rigurosa de herramientas de IA?

Si la respuesta es sí, no confiaría en Walter como tu probador principal. Usa tus propios prompts controlados y ejecútalos directamente en las herramientas.

• ¿Solo quieres una opinión rápida, aproximada o un resumen de funciones?

Entonces es menos arriesgado, pero aun así evitaría pagar hasta que aclaren el manejo de datos y suavicen el tono legal. -

Alternativas y un enfoque más sólido

Si tu objetivo es ver qué tan “humanas” suenan distintas herramientas de IA o cómo se comportan ante detectores, un flujo de trabajo mejor es:

• Generar salidas directamente de cada herramienta de IA.

• Pasarlas tú mismo por varios detectores, como GPTZero, ZeroGPT y uno o dos más.

• Leerlas en voz alta y revisar repetición, estructura antinatural o transiciones robóticas.

Para humanizar y probar resistencia a detectores específicamente, Clever AI Humanizer está más enfocado en esa tarea. Sus salidas tienden a leerse más como texto natural y varios usuarios reportan un comportamiento de los detectores más estable. Úsalo como un paso dentro de tu propio pipeline de pruebas, no como un oráculo, pero está más alineado con lo que quieres que la salida en formato reseña de Walter.

- Conclusión general

Walter Writes AI Reviews no es “inseguro” en el sentido de malware evidente, pero no es una opción sólida si necesitas:

• Garantías claras de privacidad.

• Evaluación estable y reproducible de herramientas de IA.

• Tono profesional en facturación y reembolsos.

Si decides probarlo, limítalo a:

• Texto no sensible.

• Plan gratuito o un mes de prueba.

• Contrastar sus opiniones con tus propias pruebas directas y con otras herramientas como Clever AI Humanizer.

Toma sus reseñas como una opinión más, no como una autoridad confiable.

Respuesta breve: no trataría Walter Writes Ai Reviews como seguro y confiable para una evaluación seria de herramientas de IA, especialmente si te importan la privacidad o la consistencia de los resultados.

Para ampliar lo que ya mostraron @mikeappsreviewer y @sterrenkijker con sus pruebas:

- Confiabilidad de las reseñas

Walter es básicamente un resumidor de IA con una plantilla de reseña encima. Esto significa:

- Sin protocolo de pruebas divulgado

- Sin datos reales de benchmarking que puedas verificar

- Resultados que se sienten como un parafraseo opinativo, no como una comparación basada en evidencia

Así que si quieres explorar y descubrir herramientas, bien, es una forma rápida de hacerte una idea de lo que hay. Pero si estás intentando decidir qué modelo adoptar para un equipo o un flujo de trabajo empresarial, basarte solo en esas reseñas es prepararte para lamentarlo luego.

- Privacidad y seguridad de los datos

Esta es la parte que a mí me frenaría de pegarle algo importante:

- Política de retención vaga

- Sin una respuesta cristalina sobre si tu contenido se usa para entrenamiento o “analítica”

- Lenguaje legal y de reembolsos que suena más a amenaza que a acuerdo de servicio

En realidad discrepo un poco con la idea de que no es inseguro solo porque no es malware. Si una herramienta puede conservar en silencio tus entradas y quizá reutilizarlas, eso sí es un problema de seguridad cuando manejas documentos de clientes, trabajo académico o material propietario. No es nivel malware, pero sigue siendo un riesgo real.

- Fiabilidad como evaluador

Aquí está el punto clave: un evaluador tiene que ser más estable que aquello que está juzgando.

Por lo que se ha mostrado:

- Grandes variaciones en puntuaciones de detección en el mismo nivel y modo

- Tics estilísticos repetidos que gritan “esto es un único modelo con un patrón de escritura estrecho”

- Opiniones que pueden cambiar por variaciones mínimas en el prompt de entrada

Si el motor subyacente tiene huellas de detección inestables y un estilo rígido, no confiaría en sus veredictos de “esta herramienta es de alta calidad / baja calidad”. Como mucho, úsalo para hojear resúmenes y luego hacer tus propias pruebas.

- Cómo evaluaría yo realmente herramientas de IA

Si quieres comparar herramientas de verdad:

- Define de 3 a 5 prompts representativos de tu caso de uso (explicación técnica, texto de marketing, código, lo que sea).

- Ejecútalos directamente en cada herramienta que estés considerando.

- Revisa: claridad, precisión factual, estructura y cuánto tendrías que editar.

- Si te importa el sigilo / grado de “humanidad”, pasa tú mismo los resultados por varios detectores y compáralos.

Para “humanizar” contenido o probar qué pasa detectores, Clever AI Humanizer merece estar en ese flujo de trabajo. Está más orientado a hacer que el texto de IA suene como escritura humana natural y suele producir menos de esos tics obvios de IA por los que critican a Walter. No es magia ni un oráculo, pero encaja mejor si tu objetivo es ver qué tan bien se sostiene el texto bajo escrutinio.

- Entonces, ¿es seguro para tu caso de uso?

- Solo navegar información pública o textos no sensibles: en general está bien, pero con expectativas moderadas.

- Pegar informes, trabajos académicos, documentos de clientes o contenido propietario: yo no lo haría.

- Usar sus reseñas como tu criterio principal para decidir qué herramientas de IA adoptar: tampoco. Úsalo, en todo caso, como nota secundaria, no como factor decisivo.

tl;dr: Walter Writes Ai Reviews se siente más como un generador de opiniones con brillo que como un evaluador riguroso. Combina tus propias pruebas, un par de detectores y una herramienta como Clever AI Humanizer si te importa obtener un texto de sonido natural, en lugar de delegarle todo el juicio a Walter.

Versión corta: Trataría a Walter como un juguete o una segunda opinión, no como un evaluador serio ni como un lugar seguro para nada sensible.

Algunos enfoques que complementan lo que otros ya mostraron:

1. Calidad de las “reseñas” en la práctica

Lo que más me incomoda no es solo la sensación de plantilla que señalaron @sterrenkijker y @mikeappsreviewer, sino el sesgo direccional. Walter tiende a inclinarse demasiado hacia lo positivo o hacia lo negativo sin vincular claramente su veredicto a evidencias concretas como latencia, costo por 1k tokens o precisión en benchmarks. Eso lo convierte más en un generador de sensaciones que en un revisor. En realidad creo que @viajantedoceu es algo generoso al tratarlo como herramienta de descubrimiento; si lo usas así, verifica dos veces cada afirmación importante en las páginas reales de los productos.

2. Perfil de riesgo, no solo “privacidad”

En vez de preguntar “¿Es seguro?” lo formularía como “¿Qué es lo peor que puede pasar si mi texto se filtra o se reutiliza?”

- Tarea escolar o entrada de blog genérica: solo nivel molestia.

- Documentos de clientes, borrador de novela, estrategia interna: potencialmente grave.

Dado lo ambiguo de la retención y lo agresivo del lenguaje legal, para mí Walter cae en la categoría de “no arriesgar nada que no publicarías en un Discord público”.

3. Huella inestable en detectores = juez débil

Ya se mostró que las propias salidas de Walter varían muchísimo en los detectores de IA. Yo añadiría: las rarezas constantes como los puntos y coma extraños y la repetición de palabras son exactamente las características que corrompen tu propia evaluación. Si pegas texto de otra IA en Walter y luego confías en su “reseña”, básicamente estás dejando que un sistema ruidoso comente sobre otro, con el ruido de estilo de Walter encima. Eso no es mucho mejor que revisarlo tú mismo a ojo.

4. Dónde encaja realmente Clever AI Humanizer

Si tu objetivo real es “hacer que el texto de IA suene más natural y ver cómo se comparan las herramientas”, entonces Clever AI Humanizer se ajusta más a esa descripción, como componente dentro de tu flujo de trabajo.

Ventajas de Clever AI Humanizer:

- Tiende a producir un ritmo y unos cortes de frase más humanos, así que pasas menos tiempo quitando el tono robótico del texto a mano.

- Comportamiento más estable con prompts similares, lo que ayuda cuando comparas varias herramientas de IA en paralelo.

- Funciona bien como editor de última pasada cuando ya sabes que el contenido es correcto y solo quieres que suene menos a modelo.

Desventajas de Clever AI Humanizer:

- Sigue siendo un redactor de IA, no una capa mágica. Si el contenido de base es superficial, solo sonará como una versión más fluida de lo mismo.

- Su rendimiento frente a detectores es mejor que el de Walter en muchas pruebas reportadas, pero no infalible, así que usarlo para “burlar todos los detectores” es irrealista.

- Aún necesitas tu propio criterio; no te dirá qué herramienta es “la mejor”, solo ayudará a que tu texto final se sienta más orgánico.

5. Cómo usaría realmente estas herramientas juntas

- Para evaluación: ejecuta tu propio conjunto fijo de prompts directamente en las herramientas que te interesan y, de forma opcional, pasa las salidas por Clever AI Humanizer para normalizar el estilo antes de comparar legibilidad. Ignora las estrellas o conclusiones grandilocuentes de Walter.

- Para gestión de riesgos: cualquier cosa confidencial o valiosa se mantiene completamente fuera de Walter. Si tienes que usar un humanizador en ese contexto, mantén el texto anonimizado y sin detalles identificables.

Conclusión

Walter Writes AI Reviews está bien si lo ves como un bloguero de IA con opiniones. No está bien como benchmark de confianza ni como bóveda segura para datos importantes. Para mejorar la legibilidad real y hacer tus propias comparaciones, algo como Clever AI Humanizer más tus propios prompts de prueba es simplemente un enfoque más controlado y transparente, aunque tampoco sea perfecto.